MCP Server 2026: KI mit Notion, Slack & GitHub verbinden

Was ist ein MCP-Server, wie verbindest du KI-Modelle mit Tools wie Notion, Slack, GitHub oder Vercel? Praxis-Anleitung 2026 mit Claude, ChatGPT und n8n.

Stand: 12. Mai 2026 · Von Jens Polomski.

Was ist ein MCP-Server?

Ein MCP-Server ist ein Server, der das Model Context Protocol (MCP) implementiert. Aber was bedeutet das genau? Das Model Context Protocol – entwickelt von Anthropic – ist ein offener Standard, der definiert, wie KI-Anwendungen (z. B. Sprachmodelle wie Claude oder ChatGPT) mit externen Systemen und Datenquellen interagieren können.

Kurzdefinition: Ein MCP-Server fungiert als Vermittler zwischen einer KI und der digitalen Außenwelt – vergleichbar mit einem USB-C-Anschluss für Datenkontext.

Stell dir vor, du möchtest mit einer KI sprechen, die nicht nur auf eigenes Wissen zugreift, sondern auch aktuelle Informationen aus anderen Programmen verwendet. Dazu braucht sie eine Verbindung zur Außenwelt – genau das macht ein MCP-Server.

Ein MCP-Server funktioniert ähnlich wie ein Kellner im Restaurant: Er nimmt Anfragen entgegen und liefert der KI passende Ressourcen oder Informationen. MCP bedeutet Model Context Protocol – ein standardisiertes Regelwerk, das wie ein universeller Dolmetscher oder USB-C-Anschluss für KI wirkt. Damit können verschiedene KI-Modelle problemlos mit unterschiedlichsten Datenquellen und Tools kommunizieren.

MCP Abkürzung erklärt

-

Model: die KI-Anwendung selbst.

-

Context: die Informationen, die die KI für präzise Antworten benötigt.

-

Protocol: standardisierte Regeln, um reibungslos Daten auszutauschen.

So ermöglicht MCP, dass KI intelligenter, flexibler und einfacher nutzbar wird.

Warum ist MCP wichtig für KI?

Im KI-Bereich spielt der Kontext eine entscheidende Rolle. Merkst du sicherlich auch beim Prompting von ChatGPT, was auch mittlerweile ganz gerne als Context Engineering bezeichnet wird. Denk darüber nach, wie du selbst Informationen verarbeitest. Wenn dir jemand eine Frage stellt, beziehst du nicht nur dein eigenes Wissen ein, sondern auch den aktuellen Gesprächszusammenhang, frühere Aussagen und möglicherweise externe Informationen. Genauso benötigen KI-Modelle Kontext, um sinnvolle und präzise Antworten zu liefern. Ohne den passenden Kontext sind ihre Fähigkeiten begrenzt, ähnlich wie bei einem Menschen, der versucht, ein Gespräch in einer völlig fremden Umgebung zu führen. MCP-Server helfen dabei, die „Kontextwahrnehmung" von KI-Modellen zu verbessern und ermöglichen „kontextbezogene Interaktionen".

MCP-Server fungieren als „Brücken" oder „Gateways" für KI-Modelle, um auf externe Informationen zuzugreifen. Diese externen Informationen können vielfältig sein: Dateien auf deinem Computer, Datenbanken mit wichtigen Daten, Schnittstellen zu anderen Online-Diensten (APIs) oder sogar spezialisierte Werkzeuge. Die Funktionsweise ist dabei relativ einfach: Eine KI-Anwendung (der sogenannte Client) stellt eine Anfrage an den MCP-Server. Dieser Server wiederum ist so programmiert, dass er auf die entsprechenden externen Ressourcen zugreifen, die benötigten Informationen abrufen und sie in einem für die KI verständlichen Format zurückliefern kann.

Anleitung: MCP Server direkt mit Zapier erstellen

Zapier hat einen eigenen MCP-Service veröffentlicht, der die Erstellung von MCP-Servern extrem vereinfacht. In wenigen Schritten verwandelst du ein Tool wie Claude oder Cursor von einem einfachen Gesprächspartner zu einem echten Automatisierungstalent. Hier einmal ein Video von mir zum Thema MCP bei Zapier:

So einfach geht's:

-

MCP-URL generieren

Auf der Zapier MCP-Seite „Get Started" klicken – schon erhältst du deine persönliche MCP-Server-URL. -

Aktionen definieren

Wähle aus über 8.000 Apps, welche Aktionen dein KI-Assistent nutzen soll (z. B. Tabellen füllen, LinkedIn Posts erstellen oder E-Mails verschicken). -

Mit KI verbinden

Füge die Zapier MCP-URL in den Einstellungen von Cursor, Claude oder ChatGPT Desktop ein – fertig!

Einfach, oder?

Anwendungsfälle für MCP Server

Die Anwendungsfälle für MCP-Server in der KI-Entwicklung und -Anwendung sind vielfältig. Hier sind einige typische Beispiele aus verschiedenen Bereichen:

-

Dateizugriff: MCP-Server können es KI-Anwendungen ermöglichen, lokale Dateien zu lesen und zu schreiben. Das ist nützlich, um beispielsweise Dokumente zusammenzufassen, Code zu analysieren oder neue Projekte zu erstellen. (Datenschutz beachten!)

-

Datenbanken: Durch die Anbindung an Datenbanken können KI-Modelle Informationen abrufen, Daten analysieren oder sogar Datenbankeinträge erstellen oder bearbeiten.

-

Web-Integration: MCP-Server können die Interaktion mit dem Internet ermöglichen, beispielsweise um aktuelle Informationen abzurufen, Webseiten zu durchsuchen oder mit Webanwendungen zu interagieren. Dies geht z. B. mit der Perplexity Integration.

-

Code-Entwicklung: In der Softwareentwicklung können MCP-Server in Entwicklungsumgebungen integriert werden, um beispielsweise bei der Code-Generierung, dem Erstellen von Commit-Nachrichten oder der Verwaltung von Issues auf Plattformen wie GitHub zu helfen.

-

Kommunikation: MCP-Server können die Interaktion mit Kommunikationsplattformen wie Slack oder E-Mail ermöglichen, um beispielsweise Nachrichten zu senden, Kalendereinträge zu verwalten oder Benachrichtigungen zu erhalten.

Diese MCP-Server solltest du 2026 kennen

Das MCP-Ökosystem ist 2025 explodiert. Was im Frühjahr 2025 noch eine Handvoll Referenz-Server war, ist heute ein Marktplatz mit hunderten Servern – von Notion über Stripe bis zu deiner eigenen Postgres-DB. Hier die Server, die ich in der Beratung am häufigsten einsetze:

Produktivität & Kollaboration

-

Notion MCP — Pages und Datenbanken durchsuchen, neue Einträge anlegen, Inhalte aktualisieren – direkt aus Claude oder ChatGPT. Use-Case: Meeting-Notizen automatisch in die richtige Notion-DB ablegen.

-

Slack MCP — Channels durchsuchen, Nachrichten senden, Thread-History lesen. Use-Case: „Fass mir den #ai-news Channel der letzten Woche zusammen" – direkt im Chat.

-

Linear MCP — Issues lesen, erstellen, Status updaten, Projekte abfragen. Use-Case: Bug-Reports aus E-Mails als Linear-Issues anlegen, ohne Context-Switch.

-

Google Workspace MCP — Gmail, Calendar, Drive, Docs in einem Server. Use-Case: „Schreib mir eine Antwort auf die letzte Mail von X und plane direkt ein Follow-up im Kalender."

Entwicklung & Infrastruktur

-

GitHub MCP — Repos browsen, PRs öffnen, Issues kommentieren, Code-Reviews. Use-Case: Claude Code reviewt einen offenen PR, schreibt Inline-Kommentare, mergt nach Freigabe.

-

Vercel MCP — Deployments triggern, Logs lesen, Project-Info abrufen, Env-Vars setzen. Use-Case: „Warum ist der letzte Deploy gefailt?" – Logs landen direkt im Chat.

-

Postgres / Database MCP — Read- oder Read-Write-Queries gegen deine eigene DB. Use-Case: Ad-hoc-Analysen ohne SQL-Client („Wie viele Newsletter-Signups in den letzten 30 Tagen?").

-

Sentry MCP — Error-Tracking-Issues abfragen, Stacktraces lesen, Trends analysieren. Use-Case: Den lautesten Error der Woche debuggen, ohne ins Sentry-Dashboard zu wechseln.

-

Filesystem MCP — Lokale Files lesen, schreiben, durchsuchen. Use-Case: Claude Desktop arbeitet auf deinem Projekt-Ordner wie ein lokaler Pair-Programmer.

Business & Daten

-

Stripe MCP — Customers, Subscriptions, Invoices, Refunds, Reports. Use-Case: „Wie viele aktive Abos im Plan X?" oder „Erstelle Rechnung für Kunde Y" direkt aus dem Chat.

-

HubSpot / Salesforce MCP — CRM-Kontakte, Deals, Pipelines lesen und aktualisieren. Use-Case: Lead-Recherche und CRM-Update in einem Schritt.

-

Figma MCP — Design-Files lesen, Komponenten, Variables und Frames abfragen. Use-Case: Designer übergibt Figma-Link, KI generiert direkt das passende React-Component.

Web, Search & Memory

-

Brave Search MCP — Web-Suche ohne Tracking. Use-Case: Aktuelle Recherche, ohne dass Google den Prompt mitliest.

-

Memory MCP (Anthropic) — Persistente Memory-Schicht, die sich über Sessions hinweg Fakten merkt. Use-Case: „Mein Stack ist Next 16 + Tailwind 4" einmal sagen, KI weiß es in jedem neuen Chat.

-

Fetch MCP — Beliebige URLs holen und in Markdown konvertieren. Use-Case: „Lies diesen Blogpost und fass ihn zusammen" – ohne Copy-Paste.

Eine durchsuchbare Übersicht aller verfügbaren Server findest du auf den MCP-Marktplätzen mcp.so und smithery.ai – dort sind mittlerweile mehrere hundert Server gelistet, plus die Anthropic-Referenz-Implementierungen auf github.com/modelcontextprotocol/servers.

MCP-Clients: Wo du diese Server einbindest

Ein MCP-Server allein nützt nichts – du brauchst einen Client, der ihn anspricht. Das sind 2026 die wichtigsten:

-

Claude Desktop & Claude Code — Anthropics eigene Apps, die MCP-Referenz. Konfiguration über

claude_desktop_config.jsonbzw..mcp.json. -

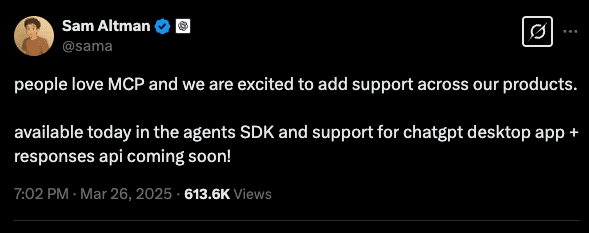

ChatGPT Desktop — OpenAI hat in Q1 2025 MCP-Support in ChatGPT Desktop ausgerollt. Verbindung über „Apps" in den Einstellungen.

-

Cursor — IDE für KI-Pair-Programming. MCP-Server lassen sich pro Projekt oder global einbinden.

-

Windsurf (Codeium) — Konkurrent zu Cursor, mit nativem MCP-Support.

-

Cline & Continue — Open-Source-Extensions für VS Code, beide MCP-fähig.

-

Zed — Schneller Rust-Editor, MCP-Integration über Assistant Panel.

-

n8n — Workflow-Automation mit native MCP-Nodes (seit 2025).

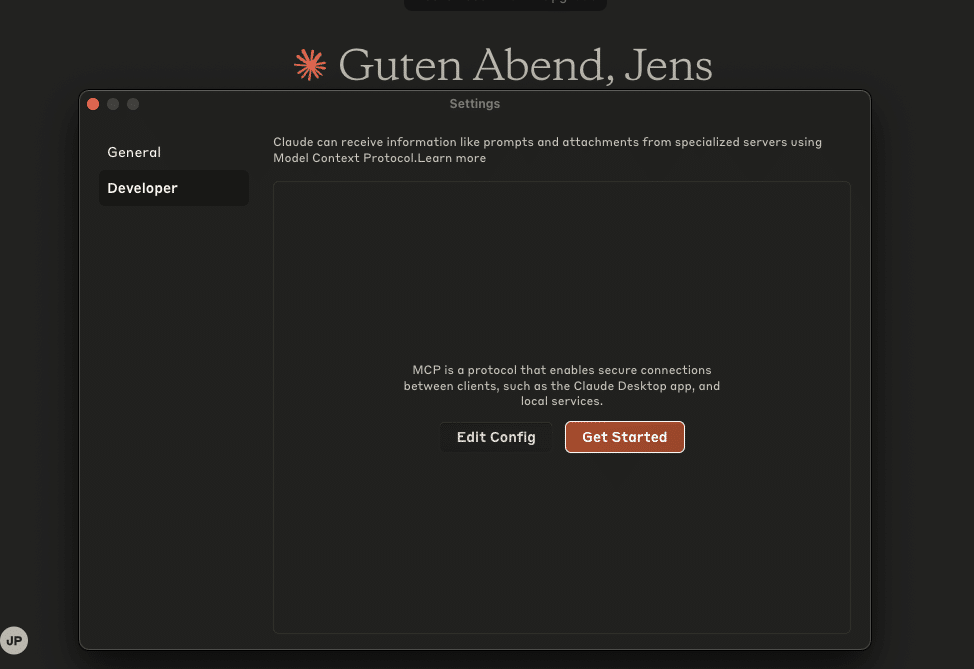

MCP in Claude verwenden

Claude unterstützt MCP-Server in der Desktop-App und in Claude Code. Die Integration gelingt in wenigen Schritten:

-

Öffne die Claude Desktop-App und gehe zu „Einstellungen".

-

Klicke auf den Menüpunkt „Developer".

-

Öffne die MCP-Konfigurationsdatei („MCP Settings") und füge dort deine generierte MCP-Server-URL ein (z. B. von Zapier) oder verweise auf ein lokales Server-Binary.

-

Speichere die Änderungen und aktiviere die Integration.

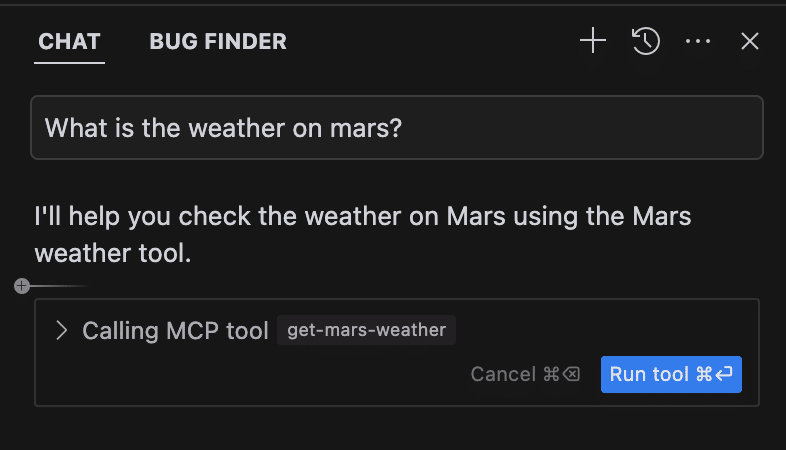

MCP in Cursor verwenden

So einfach richtest du die Verbindung ein:

-

Öffne Cursor und gehe in die Einstellungen (Settings).

-

Navigiere zum Bereich „MCP".

-

Trage deine persönliche MCP-Server-URL (z. B. von Zapier) ein.

-

Speichern – fertig!

Jetzt kann Cursor externe Tools direkt ansprechen und Aufgaben automatisieren.

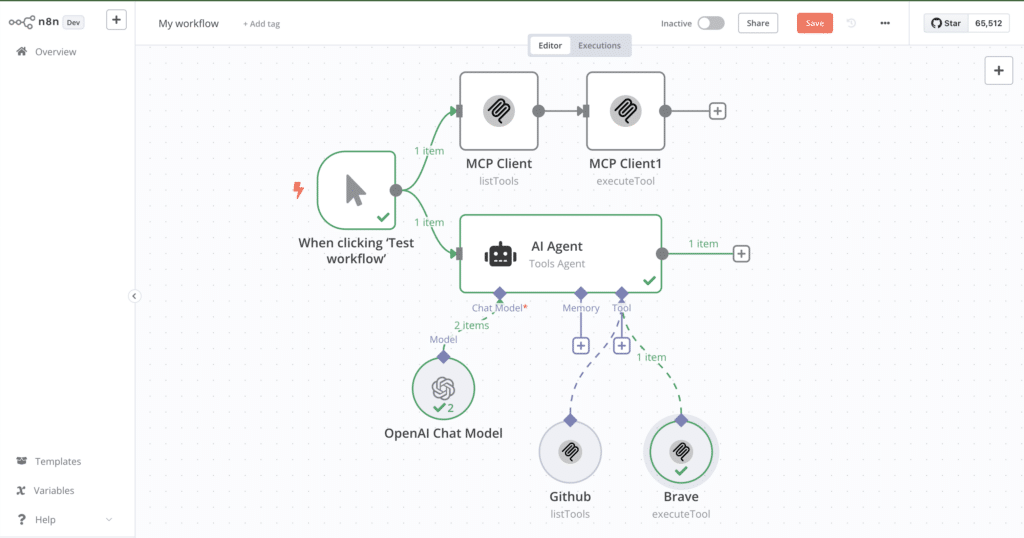

MCP in n8n integrieren

n8n hat 2025 native MCP-Nodes bekommen – du kannst MCP-Server in jedem Workflow mit wenigen Klicks anbinden. Im Node-Picker einfach „MCP" suchen, Server-URL oder Command eintragen, Tools auswählen – fertig.

Damit wird MCP auch in klassischen Automations-Workflows nutzbar: Du kombinierst Trigger (Webhook, Schedule, neue Mail), einen MCP-Node (z. B. Notion oder Slack) und nachgelagerte Steps wie gewohnt. Für Custom-Setups gibt es zusätzlich die Community-Node.

Der Stand 2026: MCP everywhere

Ein gutes Jahr nach der Anthropic-Ankündigung ist MCP der De-facto-Standard für KI-Tool-Integrationen. Die wichtigsten Punkte:

-

Alle großen LLM-Anbieter shippen MCP-Support nativ. Anthropic von Anfang an, OpenAI seit Q1 2025 in ChatGPT Desktop und im Agents SDK, Google hat Gemini- und Vertex-AI-Integrationen nachgezogen. „Welches Modell kann mein Tool ansprechen?" ist 2026 keine Frage mehr.

-

Marktplätze statt Bastelei. mcp.so, smithery.ai und das offizielle modelcontextprotocol/servers-Repo listen zusammen mehrere hundert Server. Installation ist meist ein Klick oder ein

npx-Befehl. -

Self-hosted MCP-Server für Enterprise. Wer DSGVO-konform arbeiten muss, hostet MCP-Server hinter der eigenen Firewall – mit eigener Auth, eigenen Datenquellen, ohne dass ein Byte zu Anthropic oder OpenAI fließt, das nicht der User-Prompt selbst ist.

-

Agents-Frameworks bauen darauf. OpenAIs Agents SDK, Anthropics Computer-Use-Setups, LangGraph, Mastra – alle setzen MCP als gemeinsame Tool-Layer voraus.

Was 2026 noch hakt

So weit, so gut. Wo es noch hakt:

-

Auth ist Wildwest. Jeder Server kocht seinen eigenen OAuth- oder Token-Flow. Ein einheitlicher Identity-Layer (Stichwort: OAuth 2.1 für MCP) ist in Arbeit, aber noch nicht überall ausgerollt.

-

Sicherheit & Prompt Injection. Wenn ein MCP-Server Daten aus dem Web zieht (Mails, Issues, Webseiten), kann eine bösartige Quelle die KI anweisen, andere Server zu missbrauchen. Sandboxing und granulare Permissions sind Pflicht – defaults sind oft zu großzügig.

-

Versioning. MCP-Server brechen gerne mal ihre Tools-API. Ein semver-artiges Modell ist Konsens, aber Praxis ist gemischt.

-

Beobachtbarkeit. Was hat die KI eigentlich aufgerufen, mit welchen Parametern? Logs auf Server-Seite sind machbar, aber Tooling auf Client-Seite (Audit-Trail) ist noch dünn.

Trotzdem: Wer Anfang 2025 MCP nur als „nettes Experiment von Anthropic" abgetan hat, hat ein Jahr Vorsprung verloren. Es ist die zentrale Integrationsschicht für KI im Unternehmen geworden.

Fazit: Warum du MCP im Auge behalten solltest

MCP ist 2026 nicht mehr „die Zukunft", sondern der Standard für KI-Integrationen. Ob Claude, ChatGPT, Cursor, Zapier, n8n oder Gemini – überall ist MCP die verbindende Schicht.

Warum das wichtig ist:

-

Flexibilität: KI-Tools sprechen mit beliebigen Apps und Datenquellen – ohne Custom-APIs oder Plugin-Chaos.

-

Standardisierung: Ein gemeinsames Protokoll spart Zeit, Aufwand und sorgt für Kompatibilität zwischen Modellen.

-

Skalierbar: Was du einmal als MCP-Server baust, funktioniert in jedem MCP-Client – kein Re-Build pro LLM.

-

Agenten-ready: Alle ernstzunehmenden Agents-Frameworks setzen MCP als Tool-Layer voraus.

Wenn du KI nicht nur ausprobieren, sondern sinnvoll einsetzen willst – in echten Workflows – führt 2026 kein Weg an MCP vorbei.