Text-zu-Videosequenzen (mit Kamerafahrten 😲)

In den letzten Monaten gibt es einige spannende Vorstellungen im Bereich der Generierung von verschiedenen Medien durch künstliche Intelligenz. Google und Meta haben jetzt nochmal einen draufgelegt.

Natürlich ist die Technologie und die Ergebnisse noch nicht perfekt, dennoch ist die schnelle Entwicklung total spannend zu beobachten.

Google Imagen Video: Text zu Kurzvideos

Das Projekt Imagen von Google ist schon vor ein paar Monaten gezeigt worden. Ähnlich wie bei Dall-E oder Stable Diffusion können hier Bilder durch Texteingaben erzeugt werden.

Neu ist hier aber, dass mit Imagen Video auch an Text-zu-Video gearbeitet wird. So können aus einfachen Texteingaben entsprechende Kurzvideos erzeugt werden. Natürlich sind die Videos noch nicht perfekt. Wenn man aber bedenkt, dass dies nur durch Text-Input entsteht, ist es wirklich faszinierend.

Höhere Auflösung möglich

Sowohl bei KI-Bildern also auch bei Videos ist die Auflösung und Qualität bisher noch ein Problem. Durch die Nutzung von Cascaded Diffusion Models schafft es Google hier aber, die Videos bis zu einer Auflösung von 1280×768 zu skalieren.

Quelle und weitere Videos

Auf der Imagen Video Seite, findest du weitere Beispiele und kannst selbst ein wenig rumspielen: https://imagen.research.google/video

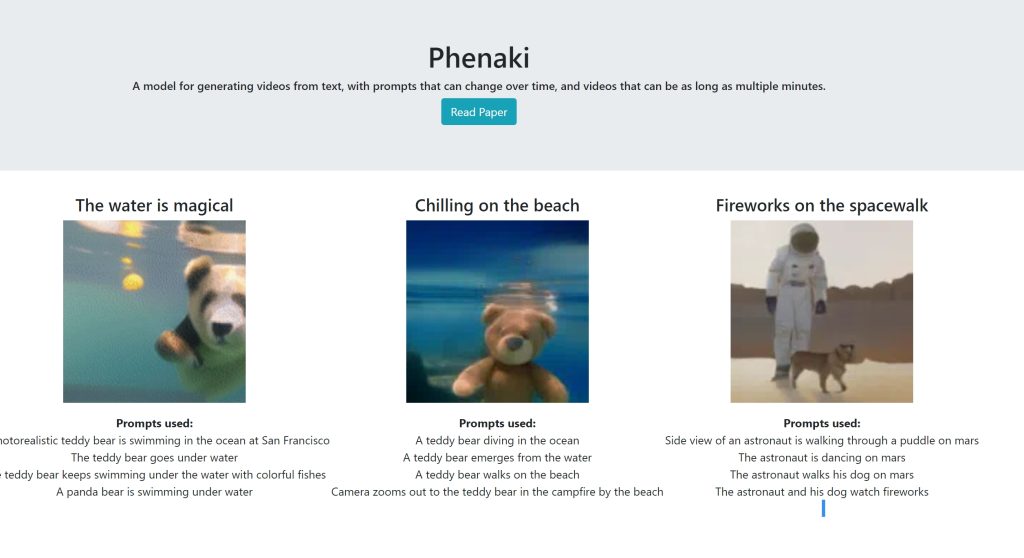

Google Projekt Phenaki - Text zu Videofrequenzen (2 Minuten)

Aber es geht noch krasser! Mit dem Projekt Phenaki können ganze Sequenzen mit Kamerafahrten erzeugt werden.

Und auch hier ist der Input nur (langer) Text. Ähnlich wie bei Imagen sind die Übergänge noch nicht sehr sauber, macht aber trotzdem Sinn und auch die Kamerafahrten können sich sehen lassen.

Quelle und weitere Videos

Auf der entsprechenden Projekt-Seite gibt es erste Beispiele sowie das entsprechend verlinkte Paper zum Projekt: https://phenaki.video/index.html

Ein Beispiel von Projekt Phenaki

Das Ergebnis

Die Texteingabe

Lots of traffic in futuristic city. An alien spaceship arrives to the futuristic city. The camera gets inside the alien spaceship. The camera moves forward until showing an astronaut in the blue room. The astronaut is typing in the keyboard. The camera moves away from the astronaut. The astronaut leaves the keyboard and walks to the left. The astronaut leaves the keyboard and walks away. The camera moves beyond the astronaut and looks at the screen. The screen behind the astronaut displays fish swimming in the sea. Crash zoom into the blue fish. We follow the blue fish as it swims in the dark ocean. The camera points up to the sky through the water. The ocean and the coastline of a futuristic city. Crash zoom towards a futuristic skyscraper. The camera zooms into one of the many windows. We are in an office room with empty desks. A lion runs on top of the office desks. The camera zooms into the lion’s face, inside the office. Zoom out to the lion wearing a dark suit in an office room. The lion wearing looks at the camera and smiles. The camera zooms out slowly to the skyscraper exterior. Timelapse of sunset in the modern city

Noch nicht für die Öffentlichkeit zuänglich

Leider (oder zum Glück) sind beide Systeme noch unter Verschluss und nicht für die Öffentlichkeit zugänglich.

Zwar sind die Videos nicht perfekt, aber es wird sicherlich nicht sehr lange dauern, bis man auch bei Videos auf den ersten Blick keinen Unterschied mehr erkennt.

Texte, Bilder und Videos mit KI erzeugen

Mittlerweile werden Tools und künstliche Intelligenz immer besser und helfen nicht nur dabei Videos, sondern auch Texte und Bilder zu erzeugen. KI-Text Generatoren gibt es mittlerweile einige und auch Tools um KI-Bilder zu generieren werden zunehmende veröffentlicht.

Kostenloser Tool-Newsletter

Mein regelmäßiger (und natürlich kostenloser) Newsletter versorgt dich regelmäßig mit neuen Tool-Vorstellungen und relevanten Neuigkeiten und Content–Empfehlungen für Marketer.

Bereits über 1.800 Abonnent*innen erhalten regelmäßig neue Tool-Vorstellungen und Updates!