KI-Bilder erkennen 2026: Die 3-Schritte-Routine vom BSI

47 % der Menschen in Deutschland glauben, dass sie KI-Bilder zuverlässig erkennen können. Die BSI-Studie 2026 zeigt: Die meisten haben sich noch nie wirklich damit beschäftigt. Hier ist die Routine, die das BSI empfiehlt – plus fünf Gewohnheiten, mit denen du dein Auge schärfst.

Es gibt eine Zahl im aktuellen Cybersicherheitsmonitor 2026 des BSI, die mich nicht loslässt: 47 % der Menschen in Deutschland sind überzeugt, dass sie KI-generierte Bilder und Videos erkennen können. Klingt erstmal nach einer guten Quote. Bis du den nächsten Wert liest: 32 % haben dafür noch nie eine der elf gängigen Prüfmethoden genutzt. Und nur 19 % prüfen die Quelle, von der das Bild kommt.

Übersetzt: Wir glauben, dass wir es können. Wir tun aber nichts dafür. Die Studie basiert auf einer repräsentativen Online-Befragung von 3.060 Personen ab 16 Jahren in Deutschland, durchgeführt im Januar 2026. Das Fokusthema: Online-Betrug und Künstliche Intelligenz. Der Tenor des Berichts ist deutlich – die technischen Möglichkeiten von Bildgeneratoren entwickeln sich schneller, als das Risikobewusstsein der Bevölkerung mithalten kann.

Für dich als Marketer ist das nicht nur ein Bauchgefühl-Problem. Es ist ein Reputationsthema. Wenn du auf LinkedIn eine "echte" Reportage teilst, die in Wahrheit aus Sora 2 oder GPT Image 2 stammt, ist dein Personal Branding beschädigt – schneller, als du den Post wieder löschen kannst. Wenn dein Team Stockbilder kuratiert und versehentlich KI-Slop einkauft, sieht deine Marke nach Spar-Stockfoto aus statt nach Premium. Und in dem Moment, in dem KI-Bilder in einer Krisenkommunikation auftauchen – Stichwort Deepfake vom CEO – brauchst du eine Routine, keine Heuristik.

Die gute Nachricht: Das BSI hat genau dafür eine Checkliste veröffentlicht. Ich habe sie auf das eingedampft, was du als Marketer realistisch in 60 Sekunden anwenden kannst – plus fünf Gewohnheiten, die dein Auge dauerhaft schärfen, und einen ehrlichen Blick auf die Detection-Tools, die wirklich helfen.

Warum dein Bauchgefühl 2026 nicht mehr reicht

Bis 2024 hatten wir bequeme Heuristiken. Sechs Finger? KI. Verbogene Schrift im Hintergrund? KI. Falscher Schattenwurf? KI. Diese Liste ist seit Anfang 2026 weitgehend tot.

GPT Image 2 rendert Text mittlerweile sauber genug, dass du Schilder, Logos und sogar mehrzeilige Plakate nicht mehr als "verbogen" enttarnen kannst. Midjourney v8 hat im März 2026 native 2K-Auflösung bekommen, was bedeutet: Auch das Heranzoomen auf Hauttextur und Stoffstruktur entlarvt nichts mehr automatisch. Sora 2 liefert Videos, in denen Hände, Kameraschwenks und Reflexionen physikalisch konsistent sind. Und Flux 2 Pro wird in Reviews offen als "kaum noch unterscheidbar von einer Editorial-Produktion" beschrieben.

Das BSI formuliert es im Kurzbericht zum Cybersicherheitsmonitor 2026 trocken: Die technischen Möglichkeiten entwickeln sich schneller als das Risikobewusstsein der Bevölkerung. Genau das ist der Punkt.

Was 2026 noch funktioniert: Plausibilitätsprüfung statt Pixel-Forensik. Du fragst nicht mehr "sieht das aus wie KI?", sondern "kann das so überhaupt stattgefunden haben, und wenn ja – wer war dabei?". Diese Verschiebung ist der Kern der BSI-Routine.

Die 3-Schritte-Routine vom BSI

Das BSI führt auf seiner Verbraucher-Seite zur KI-Bilderkennung eine Checkliste mit über 15 Punkten. Ehrlich? Niemand klappt im Tagesgeschäft eine 15-Punkte-Liste auf. Ich habe es deshalb auf drei Schritte reduziert, die der BSI-Logik folgen, aber alltagstauglich sind.

Schritt 1: Quelle prüfen (10 Sekunden)

Bevor du auf das Bild starrst, schau dir den Kontext an. Wer postet das Bild? Ist es ein verifiziertes Medium, eine bekannte Person mit Klarnamen, eine Behörde? Oder ein anonymer Account, der vor zwei Wochen erstellt wurde und seitdem nur Empörungs-Content teilt? Das BSI nennt die Quellenprüfung als ersten Reflex – und die Studie zeigt, dass nur 19 % das tatsächlich tun. Wer hier sauber arbeitet, gewinnt mehr als mit jedem Detection-Tool.

Konkret: Suche bei suspekten Bildern nach mindestens zwei unabhängigen Quellen, die dasselbe Ereignis zeigen. Echte News-Events haben fast immer mehrere Augenzeugen, mehrere Perspektiven, mehrere Outlets. KI-Fakes haben ein Hero-Bild und tausend Reposts.

Schritt 2: Rückwärtssuche oder Detektor (30 Sekunden)

Bild bei Google Lens oder TinEye hochladen. Drei Ergebnisse sind möglich:

- Das Bild taucht bei seriösen Quellen mit Datum auf → wahrscheinlich echt.

- Das Bild taucht bei dubiosen Reupload-Seiten mit identischem Wortlaut auf → klassisches Fake-/Klick-Muster, weiter vorsichtig sein.

- Null Treffer, obwohl das Motiv "viral" wirken müsste → Warnsignal. Echte virale Bilder hinterlassen Spuren, KI-generierte Bilder oft nicht.

Wenn die Rückwärtssuche unklar bleibt, wirfst du das Bild durch einen KI-Detektor. Welche taugen, klären wir gleich.

Schritt 3: Im Zweifel nicht teilen

Das ist der wichtigste Schritt – und der, den 90 % der Marketer überspringen. Das BSI formuliert ihn explizit: Verdächtige Bilder im Zweifel nicht weitergeben. Ein Re-Post auf LinkedIn dauert eine Sekunde, eine Richtigstellung dauert Tage und kostet Reichweite. Wenn du dir nach Schritt 1 und 2 nicht sicher bist, halt es zurück. Punkt.

Die Routine kostet dich im Alltag eine Minute pro Bild, das dir verdächtig vorkommt. Nicht jedes Bild, das durch deinen Feed scrollt – sondern die, bei denen dein Bauch schon "hm" sagt. Genau dafür ist sie gemacht.

5 Gewohnheiten, die dein Auge schärfen

Die BSI-Routine ist Reaktion. Damit du gar nicht erst in die Reaktion musst, hier die fünf Gewohnheiten, die ich aktiv trainiere und in Workshops vermittle.

1. Vergleichen, nicht raten

Nimm dir einmal pro Woche zehn Minuten und schau dir nebeneinander ein echtes Pressefoto und ein KI-Bild zum gleichen Thema an. Reuters hat etwa Ukraine-Reportagen als Pressebilder, parallel kursieren auf X dutzende KI-Versionen davon. Im direkten Vergleich fallen dir Sachen auf, die isoliert unsichtbar sind: zu glatte Haut, zu sauberer Hintergrund, zu perfekte Komposition. Echte Reportage ist messy.

2. Randbereich-Check

Profis schauen nicht in die Bildmitte, sie schauen an die Bildränder. Dort werden KI-Modelle bis heute am ehesten ungenau – Übergänge zwischen Objekten, Mehrfach-Stoff-Falten, Menschenmassen im Hintergrund. Wenn die Mitte gestochen scharf und der Rand unscharf-matschig ist, obwohl das Motiv keine Tiefenunschärfe rechtfertigt: Warnsignal.

3. Plausibilität schlägt Pixel

Zoom raus, nicht rein. Frag dich: Welche Story erzählt das Bild – und passt sie? Ein Foto von "Polizei nimmt Politiker fest" mit drei Polizisten in falschen Uniformen ist KI, egal wie gut der Schattenwurf ist. Das BSI nennt das "übertriebene oder unwahrscheinliche Ereignisse" – die häufigste Tarnung für Desinformation.

4. Mehrere Werkzeuge, niemals eines

Ein einzelner Detektor ist wie ein einzelner Zeuge – nicht genug. Lauf das gleiche Bild durch zwei oder drei Tools. Wenn alle "AI" sagen, ist es plausibel. Wenn sie sich widersprechen, hast du gelernt: Das Bild ist im Grenzbereich, behandele es entsprechend.

5. Mit alten Beispielen trainieren

Such regelmäßig nach prominenten Fakes, die mittlerweile als Fakes bekannt sind – Papst-Balenciaga, Pentagon-Explosion, Trump-Verhaftung. Schau sie dir aktiv an und versuche, im Nachhinein zu rekonstruieren, was an ihnen "off" war. Diese Mustererkennung übersetzt sich auf neue Fakes, auch wenn die Modelle besser werden.

Welche Detection-Tools tatsächlich helfen

Drei Detection-Tools im Vergleich · Trefferquoten aus unabhängigen 2026er Vergleichen

Ich werde regelmäßig gefragt, welcher KI-Detektor "der beste" ist. Die ehrliche Antwort: Keiner. Aber ein paar sind brauchbar, wenn du ihre Grenzen kennst.

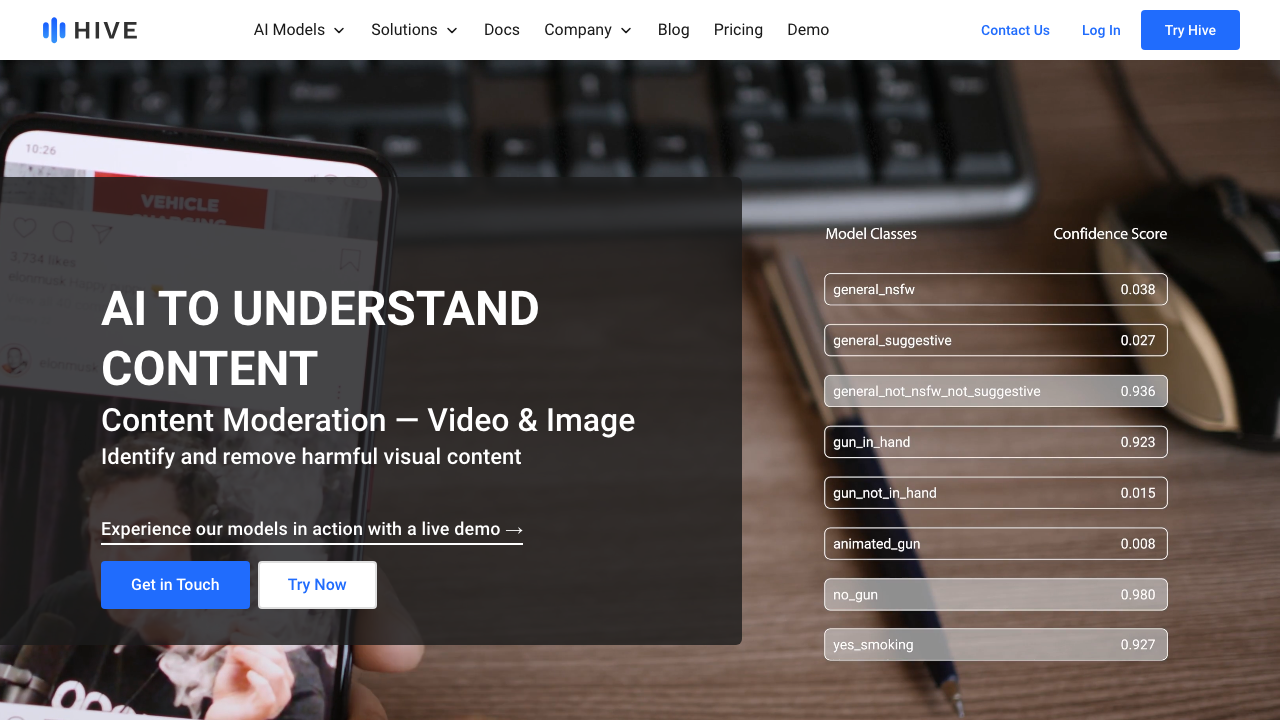

Hive Moderation ist mein Daily Driver. Liefert in Tests rund 89 % Treffergenauigkeit bei Standard-Generatoren, hat aber Probleme mit nachbearbeiteten Bildern – also genau dem, was Disinformation-Akteure tun. Brauchbar für eine schnelle Einschätzung, nicht für eine Aussage vor Gericht.

Reality Defender deckt Bilder, Videos, Audio und Dokumente ab und liegt in unabhängigen Vergleichen 2026 bei rund 91 % Genauigkeit. Stark, weil multimodal – wichtig, sobald du auch Voice-Clones oder Sora-Videos prüfen willst. Free Tier reicht für den Marketing-Alltag.

Sensity AI ist das Enterprise-Werkzeug mit der höchsten zitierten Genauigkeit (~98 %), aber preislich für Trust-and-Safety-Teams gebaut, nicht für Solo-Marketer. Wenn deine Marke ein echtes Deepfake-Risiko hat (Vorstandskommunikation, Krisen-PR), lohnt sich der Blick.

Was ich nicht empfehle: kostenlose "AI-Detector"-Webseiten ohne erkennbares Unternehmen dahinter. Viele davon sind selbst Fakes – sie geben dir eine zufällige Wahrscheinlichkeit zurück und sammeln nebenbei deine Bilder.

Die ehrliche Wahrheit zu allen Detektoren: Kein Tool erkennt zuverlässig Bilder, die durch Screenshot, Re-Encoding oder leichte Bearbeitung gegangen sind. Genau das ist aber der Standardweg, wie KI-Bilder durch Social Media wandern. Detektoren sind ein Baustein, nie das ganze Haus.

Was die Industrie versucht: C2PA & SynthID

Der bessere Weg wäre, das Problem an der Quelle zu lösen: KI-Bilder so zu kennzeichnen, dass jede Plattform sie erkennt. Genau das versuchen zwei Initiativen.

C2PA (Coalition for Content Provenance and Authenticity) ist ein offener Standard, der kryptografisch signierte Metadaten an Mediendateien anhängt – wer, womit, mit welchem KI-Anteil. Adobe, Google, Microsoft, Meta, OpenAI, BBC, Sony und über 6.000 weitere Mitglieder ziehen mit. Ab August 2026 wird C2PA durch Artikel 50 des EU AI Act faktisch zum Compliance-Pflichtthema für Anbieter, die synthetische Inhalte ausliefern.

SynthID ist Googles Antwort: ein unsichtbares Wasserzeichen, das direkt ins Pixel eingebettet wird. Mehr als 20 Milliarden Bilder sind damit bereits markiert. Der Haken: SynthID erkennt nur Google-generierte Inhalte. Bilder aus ChatGPT, Midjourney oder Flux laufen unter dem Radar.

Was im C2PA-Manifest mitwandert · Standard-Mitglieder: Adobe, Google, OpenAI, Meta, Microsoft, BBC, Sony · Pflicht durch EU-AI-Act Art. 50 ab August 2026

Praxis-Realität für Marketer 2026: Verlass dich nicht auf Wasserzeichen. Sie helfen, wenn jemand ein C2PA-Bild korrekt teilt. Sie helfen nicht, wenn jemand das Bild abscreenshotet, durch Photoshop schickt oder als JPEG re-uploaded – was 99 % der Distribution ausmacht. C2PA ist die richtige Richtung. Ankommen wird sie erst, wenn Plattformen die Credentials aktiv anzeigen, statt sie unsichtbar mitzuschleppen.

FAQ

Können Marketer KI-Bilder zu 100 % erkennen?

Nein. Schon der BSI-Cybersicherheitsmonitor 2026 zeigt, dass Selbsteinschätzung und tatsächliche Trefferquote weit auseinanderliegen – 47 % glauben, sie können es, aber selbst Profis liegen bei modernen Modellen wie Flux 2 Pro oder Midjourney v8 nur bei rund 70-80 % Trefferrate auf den ersten Blick. Realistisches Ziel ist nicht 100 %ige Erkennung, sondern eine Routine, die das Risiko eines Fehlers minimiert: Quelle prüfen, Rückwärtssuche, im Zweifel nicht teilen.

Welches Detection-Tool ist das beste?

Es gibt keinen klaren Sieger. Reality Defender überzeugt mit ~91 % Genauigkeit und Multimodal-Support, Hive ist solide für Standardfälle, Sensity ist das Enterprise-Tool mit der höchsten Genauigkeit (~98 %), aber teuer. Wichtiger als die Wahl eines einzelnen Tools ist, dass du immer mindestens zwei parallel laufen lässt. Bei widersprüchlichen Ergebnissen behandelst du das Bild als unsicher.

Reicht eine Rückwärtssuche aus?

Als alleiniges Mittel nicht. Eine Google-Lens- oder TinEye-Suche zeigt dir, ob das Bild schon woanders auftaucht und mit welcher Story es verbreitet wird. Bei vielen klassischen Fakes reicht das, weil sie als Memes wandern. Bei frisch generierten KI-Bildern findet die Rückwärtssuche oft nichts – die Abwesenheit von Treffern ist dann zwar kein Beweis, aber ein Warnsignal. Kombiniere sie immer mit Quellenprüfung und mindestens einem Detektor.

Was ist C2PA?

C2PA steht für Coalition for Content Provenance and Authenticity. Es ist ein offener technischer Standard, der digitale Inhalte mit einer kryptografisch signierten "Geburtsurkunde" versieht: Wer hat das Bild erstellt, mit welchem Tool, welche KI-Bestandteile sind enthalten. Mit über 6.000 Mitgliedern (Adobe, Google, OpenAI, Meta, Microsoft, BBC, Sony) ist C2PA der wahrscheinlichste Branchenstandard. Ab August 2026 verlangt Artikel 50 des EU AI Act maschinenlesbare Kennzeichnung – C2PA ist dafür der Favorit.

Wie trainiere ich mein Auge auf KI-Bilder?

Drei Dinge, die wirklich helfen: Erstens regelmäßig echte Pressefotos und KI-Bilder direkt nebeneinander anschauen (Reuters, AP, dpa vs. Midjourney/Flux Outputs). Zweitens bekannte Fakes nachträglich analysieren – Papst-Balenciaga, Pentagon-Explosion, fake Trump-Verhaftung. Drittens dich auf Plausibilität und Bildränder konzentrieren, nicht auf Hände oder Pixel. Wer das eine Zeit lang aktiv übt, baut sich eine Mustererkennung auf, die auch dann noch trägt, wenn die Modelle besser werden.